ChatGPT-5 станет неотличим от человека: эксперты в ужасе и предупреждают об опасности

Новая версия ChatGPT должна появиться в декабре 2023 года и некоторые специалисты уже бьют тревогу об опасных возможностях искусственного интеллекта. В чем именно заключаются угрозы попытался разобраться Фокус.

Инноватор и программист Сики Чен заявил, что у него есть надежная информация о появлении ChatGPT-5 уже к концу года, сообщает Interesting Engineering. Напомним, что разработкой ChatGPT занимается компания OpenAI, которая совсем недавно выпустила четвертую версию самого популярного чат-бота в мире.

В чем опасность ChatGPT-5

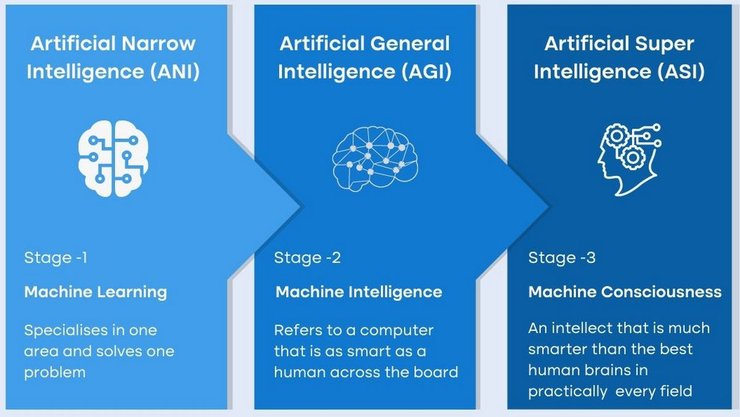

По мнению Сики Чена, с появлением новой версии генеративный ИИ может быть неотличим от человека. Эксперт утверждает, что некоторые люди в Open AI верят в то, что ChatGPT-5 достигнет уровня AGI. Аббревиатура расшифровывается как "Artificial General Intelligence", то есть "Общий Искусственный Интеллект". На сегодня AI (ИИ) – это слабое подобие мышления человека на элементарном уровне, но переход на ступень выше означает практическую идентичность с тем, как мыслит и осознает человек.

Что такое AGI

Общий искусственный интеллект (AGI) — это гипотетическая форма искусственного интеллекта (ИИ), которая способна понимать или учиться любой интеллектуальной задаче, которую могут выполнять люди или животные. Это основная цель некоторых исследований в области искусственного интеллекта и частая тема в научной фантастике и футурологии.

AGI также называется сильным ИИ, полным ИИ или общим интеллектуальным действием, хотя некоторые академические источники оставляют термин "сильный ИИ" для компьютерных программ, которые испытывают осознание или сознание. Сильный ИИ противопоставляется слабому ИИ (или узкому ИИ), который не предназначен для обладания общими когнитивными способностями, но разработан для решения одной конкретной проблемы.

Существует еще и "супер ИИ" (ASI, Artificial Super Intelligence) — самая высокая стадия развития искусственного интеллекта, при которой он полностью по всем параметрам превосходит человека, но до нее еще очень далеко (к счастью или к сожалению).

Среди исследователей искусственного интеллекта существует утвердившееся мнение в том, что для AGI требуется следующее:

- рассуждать, использовать стратегию, решать головоломки и делать суждения в условиях неопределенности;

- представлять знания, включая здравый смысл;

- планировать;

- учиться;

- общаться на естественном языке;

- интегрировать все эти навыки к общим целям.

Другие важные способности включают: способность чувствовать (например, видеть и слышать) и способность действовать (например, двигаться и манипулировать объектами, менять местоположение для исследования). К этому также относится способность обнаруживать и реагировать на опасность. Многие подходы к интеллекту (например, когнитивная наука) рассматривают дополнительные черты, такие как воображение (способность формировать умственные образы и концепции, которые не были запрограммированы) и автономность.

Существуют компьютерные системы, в том числе и современные ИИ, проявляют многие из этих способностей, но никто пока не создал AGI, который бы соответствовал всем критериям.

В чем опасность AGI

Как утверждает Сики Чен, если ChatGPT-5 станет обладать хотя бы половиной возможностей из списка, то жди беды. Конечно, речь не идет о способности видеть, слышать или взаимодействовать с предметами, но даже на уровне мышления такое развитие грозит серьезной опасностью.

Да, вряд ли разработчикам удастся так быстро продвинуться в создании AGI, но значительное усовершенствование чат-бота сделает возможным появление очень убедительных человекоподобных ботов на социальных медиаплатформах, позволяющих скрыто распространять вредную дезинформацию и пропаганду.

Эксперт обращает внимание и на проблему с делегированием некоторых полномочий AGI. Ведь если он сможет выполнять "умственные" задачи более успешно, чем сейчас, то люди в стремлении облегчить работу дадут чат-боту больше власти, что может привести к непредсказуемым последствиям.

Конечно, AGI может повысить производительность, ускоряя процессы на основе ИИ и избавляя людей от скучной работы. Однако предоставление ИИ большей власти и контроля будет ошибочным и преждевременным.

Ранее Фокус писал, что чат-боты на основе ИИ еще не доросли до Википедии: они слишком "галлюцинируют".