На уровне с ядерным оружием: какую угрозу атака Китая с ИИ несет миру и что делать Украине

Китайские хакеры впервые провели масштабную атаку с помощью искусственного интеллекта без существенного вмешательства человека. Это открывает новую эпоху технологий и может привести к появлению мощного кибероружия на войне в Украине.

Системы искусственного интеллекта имеют огромный потенциал, ведь превосходят людей во многих задачах, в том числе и во вредных. Фокус узнал, чем это грозит Украине и другим государствам, и можно ли защититься от подобных операций.

Кибератака Claude Code: как "завербовали" ИИ

В середине сентября 2025 года Anthropic, разработчик модели ИИ Claude, обнаружила сложную шпионскую кампанию. Группа, спонсируемая китайским правительством, использовала инструмент Claude Code, чтобы проникнуть в систему примерно 30 целей по всему миру, и кое-где преуспела. Жертвами стали крупные технологические компании, правительственные, финансовые и промышленные учреждения.

"Мы считаем, что это первый задокументированный случай масштабной кибератаки, реализованной без существенного вмешательства человека", — отметили специалисты Anthropic в своем отчете.

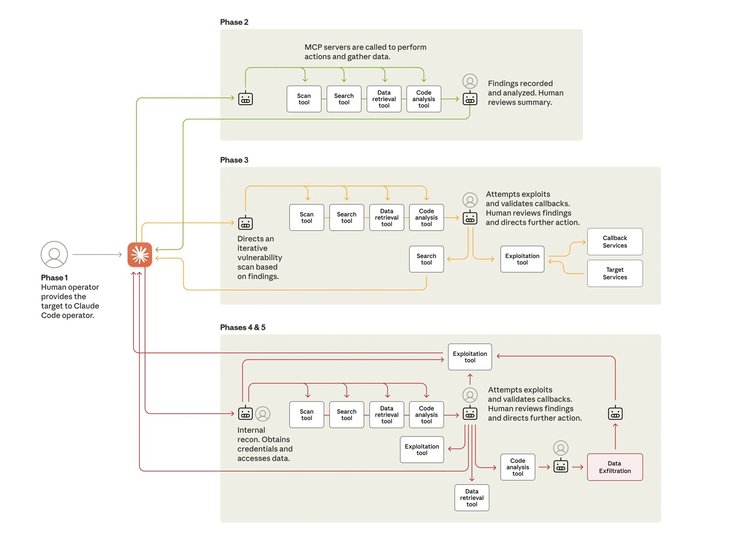

Атаки основаны на функциях моделей искусственного интеллекта, которых еще год назад не существовало или они были на значительно более низком уровне развития. Операторы-люди планировали операции, а затем использовали агентов ИИ для автономного взлома целей.

Claude Code выступил автоматизированным инструментом для проведения кибератак. Китайские хакеры разбили атаки на небольшие задания и попросили ИИ их выполнить, не объясняя контекста. Таким образом они обошли защитные механизмы Claude, которые предупреждают вредоносное поведение. Злоумышленники также представились сотрудниками фирмы по кибербезопасности и сообщили, будто проводят тестирование систем защиты.

Сначала ИИ провел разведку, обнаружил самые ценные базы данных жертв и проверил инфраструктуру жертв. Далее он обнаружил уязвимости систем и написал код эксплойта (вредоносного ПО). Далее группа с помощью Claude собрала логины с паролями, упорядочила по ценности и получила доступ, чтобы украсть ценные данные и структурировать их. Напоследок, ИИ подготовил документы и файлы, которые можно использовать для дальнейших атак.

Преимущества ИИ над хакерами-людьми

Искусственный интеллект выполнил 80-90% всей работы, а участие людей понадобилось только в 4-6 критических моментах во время одной атаки, даже несмотря на то, что система ошибалась: выдумывала или искажала информацию. Команде людей понадобилось бы значительно больше времени, говорят в Anthropic.

Чтобы лучше оценить историю и ее последствия, Фокус обратился к Евгению Поремчуку, офицеру Сил Обороны Украины, специалисту по кибербезопасности, исследователю влияния искусственного интеллекта на современные киберугрозы. По его словам, атаки с участием ИИ выделяются масштабом, скоростью и скрупулезностью.

"Агент ИИ может параллельно "вести" десятки целей 24/7, автоматизируя рутину: сканирование, перебор паролей, анализ логов (журналов событий), эксплуатацию уязвимостей, "закрепление" на цели и получение информации. В случае с китайскими хакерами, Claude Code фактически взял на себя большую часть операции: от разведки до выбора данных для кражи и даже расчета суммы выкупа", — отметил военный.

Если человека-хакера можно нанять, пообещав деньги или другие ценности, то с искусственным интеллектом такой подход не сработает. Известные ныне коммерческие модели имеют ограничения, заложенные разработчиками: табуированные темы, которые нельзя обсуждать, или задачи, которые нельзя выполнять.

Случай с Claude, показывает, что можно найти способы, чтобы эту защиту обойти, но это тоже требует немалых усилий и креативности. Например, недавнее исследование группы по безопасности искусственного интеллекта DEXAI и Римского университета Ла Сапиенца показали, что некоторые развитые модели ИИ можно обмануть с помощью стихов и получить от них инструкцию по созданию ядерного оружия.

Искусственный интеллект — новое оружие

На этот раз прокитайские хакеры использовали систему американской компании Anthropic, которая имеет встроенные механизмы защиты от вредоносного поведения, однако не исключено, что в следующий раз Китай применит свою отечественную модель DeepSeek или же создаст искусственный интеллект, специально предназначенный для проведения кибератак.

Как говорит Евгений Поремчук, технически такое кибероружие создать вполне реально, и барьер для вхождения только падает с развитием отрасли. Государство может научить модель ИИ выполнять задачи активных наступательных операций в кибердомене: автоматизация сканирования, эксплуатации, работы с инфраструктурой ботнетов и тому подобное. Однако такие действия могут нарушить международное право и привести к серьезным политическим последствиям.

Украина или Россия может использовать технологию против врага во время войны, например как элемент уже активных киберопераций. ИИ-агенты могут ускорить поиск уязвимостей в промышленных системах, автоматизировать анализ конфигураций, подбор сценариев атак на энергетику, связь, логистику и т.д.

"Обладание эффективным кибероружием, может стать не менее важной "красной кнопкой", чем ядерное оружие, и весомым аргументом на межгосударственных переговорах. И я надеюсь, что именно Украина выйдет страной-победителем в гонке "ИИ-оружия"", — отметил специалист.

Защита от атак ИИ

Полностью предупредить кибератаки невозможно, однако разработчики способны сильно усложнить злоупотребления. Anthropic, например, уже ввел отдельные классификаторы для выявления вредоносных сценариев, блокирует аккаунты и делится индикаторами компрометации с партнерами. Проблема в том, что всегда есть"джейлбрейки", обходные формулировки, а также модели с открытым доступом, где никто не устанавливает цензуру.

Учитывая, что хакерские атаки будут только масштабироваться то и государству, и бизнесу нужно перейти от "пассивной кибербезопасности" к модели постоянной активной защиты, считает офицер ВСУ. Для защиты государственных учреждений он порекомендовал следующее:

- внедрить национальные стандарты на базе ISO 27001 / NIST CSF для госорганов и критической инфраструктуры;

- внедрить централизованную систему управления уязвимостями: государственный реестр активов, обязательные CVE-сканирования, контроль конфигураций;

- внедрить национальные платформы мониторинга, способные анализировать трафик, логи и аномалии с использованием собственных моделей ИИ;

- использовать автоматизированный Red Team at Scale (имитации хакерских атак) для госсектора — регулярные проверки на проникновение. платформы вроде Stratex Vector, Acunetix, Tenable Nessus, OpenVAS могут стать незаменимыми помощниками.

В Украине этот вопрос неплохо решается благодаря Команде реагирования на компьютерные чрезвычайные события Украины (Computer Emergency Response Team of Ukraine, абр. CERT-UA). Кроме того, специалисты внедряют стандарты и чек-листы проверки кибербезопасности для органов власти.

Для защиты бизнеса нужны другие пути. Евгений предложил следующие ключевые шаги:

- создать инвентарь цифровых активов: невозможно защитить то, что забыли;

- регулярные автоматизированные сканирования по модели "как видит вас хакер". Конкретнее, платформы вроде Stratex Vector/Acunetix/Tenable Nessus/OpenVAS могут стать незаменимыми помощниками.

- техническая сегментация сети — максимум изолировать критические части бизнеса.

- Мониторинг аномалий с ИИ-анализом, который видит поведенческие паттерны, а не только сигнатуры.

- внедрить политику Zero Trust: никаких "доверенных" зон, все запросы проверяются.

- гигиена доступов: MFA, контроль привилегий, регулярное удаление "мертвых" аккаунтов.

- план восстановления после инцидентов, который реально тестируют, а не держат в PDF.

Что будет, если ИИ выйдет из-под контроля?

По мнению Евгения Поремчука, "восстание машин", как в фильме "Терминатор", вряд ли произойдет в реальности. Скорее, произойдет неуправляемая эскалация: агент, который массово эксплуатирует уязвимости без четких ограничений по целям, может задеть больницы, спасательные службы, гражданскую инфраструктуру, рассылает письма и тому подобное. Также возрастает риск ошибочной атрибуции и политического кризиса.

"ИИ наделает глупостей (например представит себя агентом спецслужбы одной из стран, придумает себе страну-врага и нагенерирует заданий направленных на дискредитацию этой страны, а ответ прилетит уже по государству, которое сочтут виновным. Примерно так вижу возможный негативный сценарий работы обезумевшего ИИ-агента. На самом деле, если очень хочется поволноваться на эту тему, то рекомендую подумать над тем, что ИИ модели интегрируют в боевые дроны", — подытожил специалист.

Ранее стало известно, что Украина создаст собственный ИИ. Как заявил вице-премьер-министр Михаил Федоров, украинские разработчики получат доступ к специализированному программному обеспечению благодаря сотрудничеству с американской компанией NVIDIA.

Писали также, что искусственный интеллект готов убивать людей ради собственных интересов. Компания Anthropic провела исследование среди 16 моделей, включая собственную Claude.