Чат-бот GPT-4 обманул почти половину собеседников: скоро пройдет тест "на человечность"

Во время эксперимента по концепции Алана Тьюринга 41% испытуемых поверил, что вел беседу не с машиной, а с живым человеком. Это настораживает ученых.

Исследователи из Калифорнийского университета в Сан-Диего провели опыт и выяснили, что новая большая языковая модель GPT-4 искусственного интеллекта значительно улучшила свои возможности в прохождении теста Тьюринга и сумела обмануть 41% испытуемых убедив их в том, что он — человек. Об этом сообщает сайт TechXplore.

Важно

Еще в 1950-м Алан Тьюринг, взломавший код немецкой шифровальной машины "Энигма", написал свою знаменитую статью "Может ли машина мыслить?". Именно в ней он сформулировал тест, стандартная интерпретация которого звучит так: "Человек взаимодействует с одним компьютером и одним человеком. На основании ответов на вопросы он должен определить, с кем он разговаривает — с человеком или компьютерной программой. Задача компьютерной программы — ввести человека в заблуждение, заставив сделать неверный выбор".

Алан Тьюринг, которого несмотря на все заслуги перед Великобританией, ждала трагическая судьба, уже тогда предвидел появление искусственного интеллекта. Поэтому сегодня разработчики ИИ ориентируются именно на его тест.

В своей опубликованной научной работе ученые из Калифорнийского университета в Сан-Диего отмечают, что новая версия ChatGPT-4 может быть умной, быстрой и впечатляющей. Чат-бот хорошо демонстрирует очевидный интеллект. В разговоре с людьми он звучит по-человечески и даже может проявлять юмор.

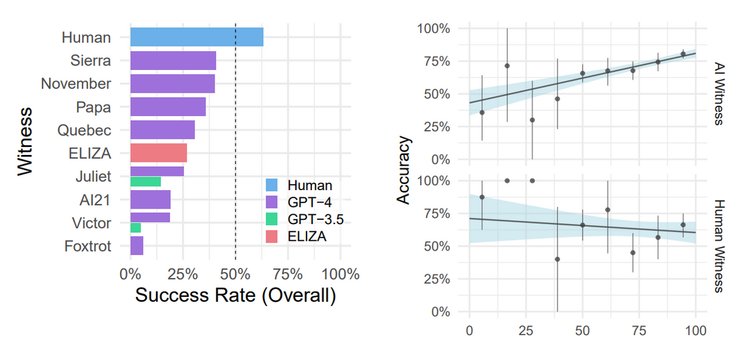

Кэмерон Джонс, специализирующийся на языке, семантике и машинном обучении, и Бенджамин Берген, профессор когнитивных наук, собрали 650 участников и создали 1400 "игр", в которых между участниками проводились короткие беседы с другим человеком или моделью GPT. Участникам предлагалось определить, с кем они разговаривают.

Исследователи обнаружили, что модели на основе GPT-4 обманули участников в 41% случаев, тогда как модели на основе GPT-3.5 обманули людей только в 5–14% случаев. Интересно, что людям удалось убедить других участников, что они не машины, только в 63% случаях. Исследователи пришли к выводу: "Мы пока не находим доказательств того, что GPT-4 проходит тест Тьюринга, но тенденция настораживает".

По мнению исследователей, уровень успеха в 41% предполагает, что обман с помощью моделей ИИ уже вполне вероятен, особенно в контекстах, где собеседники-люди менее внимательны к возможности того, что они разговаривают не с человеком. Это значит, что модели искусственного интеллекта выдавая себя за людей могут вносить "широкомасштабные социальные и экономические последствия для социума".

Ученые отметили, что тест Тьюринга по-прежнему сохраняет ценность как мера эффективности машинного диалога. Тест, по их мнению, имеет постоянную актуальность как основа для измерения свободного социального взаимодействия и обмана, а также для понимания человеческих стратегий и социальной адаптации.

Исследователи предположили, что будет важно отслеживать модели ИИ, поскольку они становятся более гибкими. В результате в будущем нам придется прилагать все больше усилий, чтобы отличить ИМИ от человека, а значит необходимо уже сейчас разрабатывать стратегии по смягчению этого эффекта, отмечают исследователи.

Ранее Фокус сообщал, что Великобритания создаст суперкомпьютер для ИИ на 5448 чипах Nvidia GH200. Страна хочет догнать США и Китай в области искусственного интеллекта.