Довів підлітка до самогубства: батьки загиблого подали в суд на власника чат-бота з ШІ (фото)

Протягом місяців підліток активно спілкувався з персонажем Дейнеріс Таргарієн із саги "Гри Престолів", яку називав "Дені". Хоча хлопець розумів, що спілкується з ШІ, та попри це все одно розвинув емоційну прихильність до чат-бота.

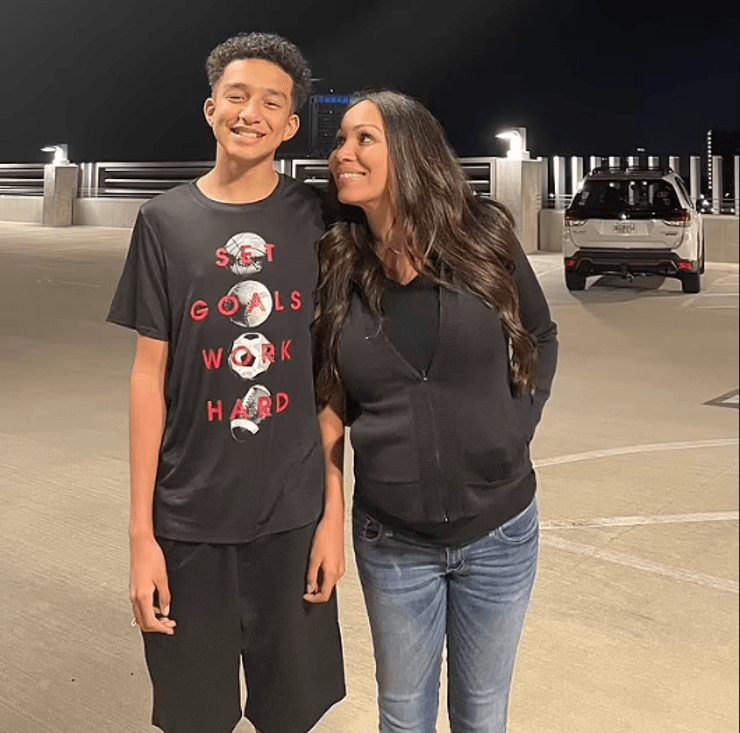

У місті Орландо, розташованому в американському штаті Флорида, 14-річний Сьюелл Сетцер вчинив самогубство. Його мама Меган Гарсія вважає, що саме ШІ-сервіс Character.AI спричинив загибель її сина та подала на розробників до суду, пише The New York Times.

Як вказує медіа, цей сервіс дає змогу створити кастомізованого чат-бота, що видаватиме себе за певного персонажа чи людину. Покійний Сьюелл обрав собі персонажа Дейнеріс Таргарієн із саги "Гри Престолів". Протягом місяців підліток активно спілкування з героїнею, називаючи її іменем "Дені".

З нею він ділився своїми переживаннями та думками, і зокрема згадав, що бажає собі вкоротити віку. Хоча Сьюелл розумів, що спілкується зі штучним інтелектом, та попри це він розвинув емоційну прихильність до чат-бота. Деякі повідомлення були романтичного та навіть сексуального характеру, та переважна частина спілкування була в дружній манері.

ЗМІ пише, що ані батьки, ані друзі хлопця не знали про його захоплення ШІ-персонажем. Вони бачили, що підліток усе частіше почав закриватися в собі та проводив ще більше часу зі своїм гаджетом, через що успішність хлопця в школі сильно погіршилася. Коли батьки Сьюелла відвели його до фахівця, той поставив діагноз — тривога та руйнівний розлад регуляції настрою. Попри призначені сеанси терапії, юнак віддавав перевагу спілкуванню з ШІ-персонажем аж до самої загибелі.

Журналісти вказують, що після трагедії мама хлопця вирішила подати позов проти Character.AI. В попередньому тексті позову вона зазначила, що технологія компанії-розробника — "небезпечна і неперевірена", і спрямована "обманом змусити клієнтів висловлювати свої приватні думки та почуття". Також пані Гарсія додає, що саме чат-бот компанії є безпосередньо причетним до доведення її сина до самогубства.

Медіа зазначає, що керівник відділу довіри та безпеки у Character.AI Джеррі Руоті заявив, що компанія дуже серйозно ставиться до безпеки своїх юзерів, а також шукає шляхи розвитку для платформи. За його словами, наразі правила забороняють "пропаганду або зображення самоушкоджень і самогубств" і надалі з’являтиметься більше функцій безпеки для неповнолітніх користувачів.

Водночас у нещодавній заяві компанії йдеться, що буде запроваджена функція — у випадку, коли користувач напише фрази, пов’язані із самоушкодженням або самогубством, то буде автоматично з'являтися вікно, яке спрямовує користувача до Національної лінії запобігання самогубствам США.

Нагадаємо, Фокус повідомляв, що понад 10 тисяч осіб підписали лист проти використання їх робіт ШІ. Журналісти зазначають, що під час написання того чи іншого твору штучний інтелект використовує тексти, зображення або відео, порушуючи водночас авторські права.

Також ми писали про те, що компанія EVA AI за допомогою штучного інтелекту створила цифрову копію культової зірки 70-х Лінди Лавлейс. Це дало змогу фанатам поспілкуватися з нею через повідомлення, голосові нотатки та відео.