Довел подростка до самоубийства: родители погибшего подали в суд на владельца чат-бота с ИИ (фото)

В течение месяцев подросток активно общался с персонажем Дейнерис Таргариен из саги "Игры Престолов", которую называл "Дени". Хотя парень понимал, что общается с ИИ, но несмотря на это все равно развил эмоциональную привязанность к чат-боту.

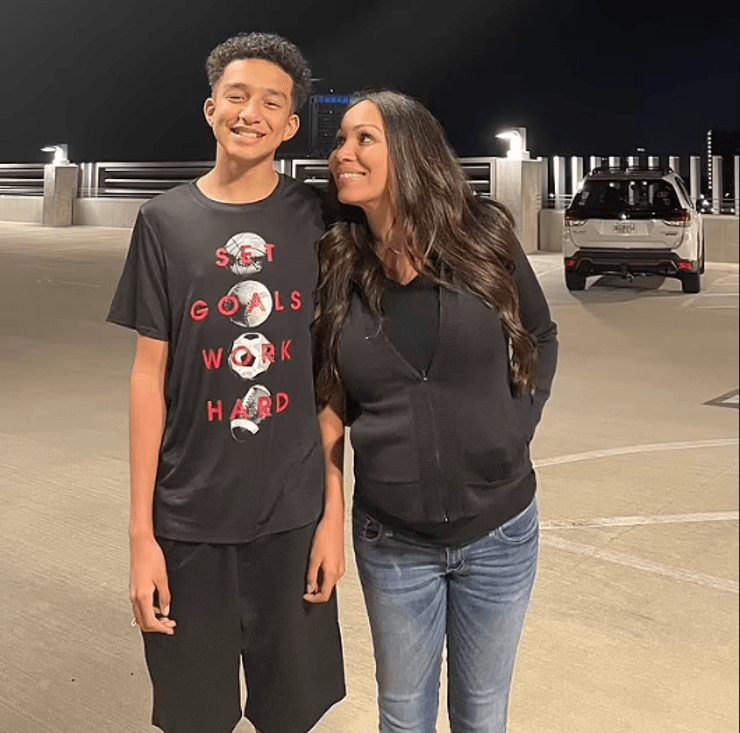

В городе Орландо, расположенном в американском штате Флорида, 14-летний Сьюэлл Сетцер совершил самоубийство. Его мама Меган Гарсия считает, что именно ИИ-сервис Character.AI стал причиной гибели ее сына и подала на разработчиков в суд, пишет The New York Times.

Как указывает медиа, этот сервис позволяет создать кастомизированного чат-бота, который будет выдавать себя за определенного персонажа или человека. Покойный Сьюэлл выбрал себе персонажа Дейнерис Таргариен из саги "Игры Престолов". В течение месяцев подросток активно общался с героиней, называя ее именем "Дени".

С ней он делился своими переживаниями и мыслями, и в частности упомянул, что желает себе укоротить жизнь. Хотя Сьюэлл понимал, что общается с искусственным интеллектом, но несмотря на это он развил эмоциональную привязанность к чат-боту. Некоторые сообщения были романтического и даже сексуального характера, но большая часть общения была в дружеской манере.

СМИ пишет, что ни родители, ни друзья парня не знали о его увлечении ИИ-персонажем. Они видели, что подросток все чаще начал закрываться в себе и проводил еще больше времени со своим гаджетом, из-за чего успеваемость парня в школе сильно ухудшилась. Когда родители Сьюэлла отвели его к специалисту, тот поставил диагноз — тревога и разрушительное расстройство регуляции настроения. Несмотря на назначенные сеансы терапии, юноша предпочитал общение с ИИ-персонажем вплоть до самой гибели.

Журналисты указывают, что после трагедии мама парня решила судиться против Character.AI. В предварительном тексте иска она отметила, что технология компании-разработчика — "опасная и непроверенная", и направлена "обманом заставить клиентов выражать свои частные мысли и чувства". Также госпожа Гарсия добавляет, что именно чат-бот компании непосредственно причастен к доведению ее сына до самоубийства.

Медиа отмечает, что руководитель отдела доверия и безопасности в Character.AI Джерри Руоти заявил, что компания очень серьезно относится к безопасности своих пользователей, а также ищет пути развития для платформы. По его словам, что сейчас правила запрещают "пропаганду или изображение самоповреждений и самоубийств" и в дальнейшем будет появляться больше функций безопасности для несовершеннолетних пользователей.

В то же время в недавнем заявлении компании говорится, что будет введена функция — в случае, когда пользователь напишет фразы, связанные с самоповреждением или самоубийством, то будет автоматически появляться окно, которое направляет пользователя к Национальной линии предотвращения самоубийств США.

Напомним, Фокус сообщал, что более 10 тысяч человек подписали письмо против использования их работ ИИ. Журналисты отмечают, что при написании того или иного произведения искусственный интеллект использует тексты, изображения или видео, нарушая при этом авторские права.

Также мы писали о том, что компания EVA AI с помощью искусственного интеллекта создала цифровую копию культовой звезды 70-х Линды Лавлейс. Это позволило фанатам пообщаться с ней через сообщения, голосовые заметки и видео.