Повстання машин не буде: ШІ хочуть загнати у жорсткі межі, щоб уникнути проблем

Попри те, що регулювання нейромереж вкрай необхідне, проблеми вже почалися.

У ЄС прислухалися до голосу світової наукової спільноти й раніше, ніж у США, написали закон, що регулює застосування штучного інтелекту. Втім, цей закон ще обговорюватиметься і доповнюватиметься цілий рік до моменту ухвалення, а поки що є час подумати над тим, наскільки він відображає сьогоднішні реалії. Може, вже пізно щось змінювати та настала ШІ-анархія?

Як у ЄС мають намір врегулювати розвиток ШІ

У законі пропонується розділити інструменти ШІ на "чотири зони ризику": мінімальний, обмежений, високий та неприйнятний. Наприклад, антивірусні рішення або спам-фільтри на основі нейромереж, звичайно ж, потрапляють під категорію "мінімального ризику" і для їхньої роботи немає обмежень.

А ось генеративні мережі (що створюють фото, відео та звук) є інструментами "середнього ризику". У законі пропонується компаніям-розробникам чітко маркувати такий контент відповідною позначкою, щоб будь-яка людина могла відразу зрозуміти, що перед нею не справжнє фото. Очевидно, в ЄС зрозуміли, наскільки небезпечні фейкові фото "Папи Римського в модній куртці" або "арешту Дональда Трампа", згенеровані за допомогою Midjourney.

Але саме тут законодавці запізнилися. Звичайно, відомі компанії типу Adobe, Microsoft або Midjourney і так позначають твори своїх нейромереж відповідним знаком і навіть запровадили заборону на генерацію фото відомих особистостей та провокаційних запитів на тему насильства, наркотиків тощо. А ось що робити з альтернативними нейромережами? Наприклад, Stable Diffusion може створювати зображення реальних людей. І таких "фейків" стає дедалі більше, проте серед них є проєкти з відкритим кодом, тож будь-який програміст може їх розвивати далі.

Радше за все, цей пункт закону введений суто для місцевих ІТ-компаній, адже ніхто не може заборонити генерувати політичні фотофейки або навіть діпфейки громадянам Росії або Китаю, а інструменти для цього вже є.

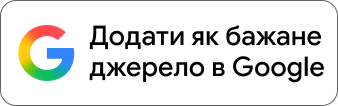

Влада цих країн уже вважає ШІ одним із головних стовпів підтримки політичних режимів. У Китаї працює система "соціального рейтингу" благонадійності громадян, а Росія активно використовує нейромережі для пошуку опозиції та моніторингу критики Путіна у соцмережах. І взагалі, згідно з репозиторієм інцидентів з ШІ, їхня кількість збільшилася у 26 разів у порівнянні з попередніми роками.

Мало того, інструментарій для створення відео та голосових діпфейків вже доступний широкому колу користувачів, і хоча поки що в ЄС подібні генеративні інструменти підпадають під "середню загрозу", ми більш ніж впевнені, що до моменту голосування цього закону вони будуть віднесені до розділу "високого ризику". Просто порівняйте, як ще менше пів року тому генерував картинки той же Midjourney, і що він уміє зараз.

Які сфери діяльності закриють від ШІ

Втім, автори законопроєкту змогли передбачити суттєвіші проблеми, яким загрожує неконтрольована інтеграція нейромереж у важливі аспекти людського життя. Наприклад, у законопроєкті прописано заборону використання ШІ в судовому провадженні (оцінка чи аналіз за допомогою мереж доказової бази).

Також не можна використовувати нейромережі для оцінки кандидатів на роботу (обробляти резюме). І ось тут Євросоюз б'є на випередження, оскільки, згідно з дослідженнями, 49% респондентів побоюються втратити роботу через запровадження ШІ. Причому найбільше ці побоювання виникають у представників так званого "офісного планктону", ніж у робітничого класу, хоч і їм є про що задуматися — роботизація підприємств просувається не менш активно, ніж використання інструментів ШІ.

У законопроєкті також прописані корисні норми про те, що ШІ забороняється розділяти людей за расами та національностями. Під заборону потрапляють системи розпізнавання емоцій. Ця заборона діє для правоохоронців, щоб вони не могли використовувати інструменти на основі ШІ для аналізу міміки людини та її психологічного настрою. Це може загрожувати неправильними висновками про винність чи невинність підозрюваного.

А що робитимуть організатори Олімпіади 2024 року у Франції? Якщо закон ухвалять до цього часу, їм буде заборонено використовувати нейромережі для контролю над натовпом уболівальників. Місцеві правоохоронці збираються використовувати нейромережі для збирання та аналізу "підозрілої чи ненормальної" активності в натовпі.

Один із найспірніших моментів – заборона на збір та аналіз біометричних даних із соцмереж та з камер спостереження, за якими потім можна було б розпізнавати громадян. Хоча для правоохоронців в окремих випадках зробили виняток – наприклад, запобігання терактам, серйозним злочинам або пошуком зниклих людей, проте все одно доведеться отримувати в кожному конкретному випадку дозвіл судді, що тягне за собою паперову тяганину.

Знову ж таки, у недовірливих громадян та інших любителів теорій змови цілком виникає резонне питання: хто заважає використати всі ці чудові напрацювання спецслужбам? Навряд чи закон торкнеться органів національної безпеки.

До речі, у цьому випадку Україна, яка прагне потрапити до ЄС, перебуває під ударом. Ми вже розповідали, що ЗСУ та розвідка активно використовують програму компанії Clearview AI для впізнання та розпізнавання осіб окупантів. Мабуть, якщо закон набуде чинності, у майбутньому доведеться від цього відмовитися, хоча у планах Мінцифри подальша активна співпраця з Clearview AI.

Безперечно, дуже добре, що в законопроєкті прописані чіткі межі на використання нейромереж у медицині. Такі системи повинні будуть "досконало вивчені та протестовані в аспекті надійності та безпомилковості".

Про що забули у законопроєкті "про ШІ"

Звичайно, соціальні питання щодо правосуддя, медицини, персональних даних та працевлаштування – це чудово, але поки що немає жодного пункту щодо використання ШІ у військових системах чи впливу нейромереж на екологію. А вже відомо, що той самий Пентагон активно працює над військовими технологіями з використанням штучного інтелекту. Поки що, в основному, йдеться про системи керування та відстеження ракет, але з'являються новини про роботизовані системи та навіть винищувач F-16 як експеримент цілих 17 годин керувався ШІ.

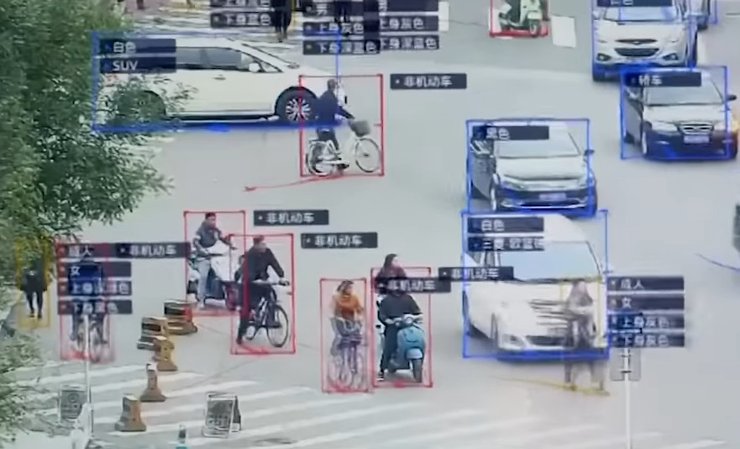

Проблему для екології, яку створює розвиток нейромереж, так само не варто відкидати. Адже за підрахунками вчених, навчання та функціонування нейромереж потребує величезних енергетичних та ресурсних витрат. Згідно з дослідженням, середній ЦОД використовує близько 3,8 л води на кожну кіловат-годину енергії. Втім кожен запит людини до ChatGPT тимчасово забирає у природи літрову пляшку води.

Зі більшим розвитком нейромереж компаніям доведеться застосувати всі способи, щоб максимально знизити тиск на природу, адже досі безліч ЦОД, на серверах яких "крутиться" ШІ споживають енергію електростанцій, що працюють на газу та вугіллі. Це ніяк не сприяє прагненням ЄС щодо переходу на систему нульових викидів.