Чат-боти на основі ШІ ще не доросли до Вікіпедії: вони надто "галюцинують"

Співзасновник всесвітньої електронної енциклопедії вважає, що ШІ ще не готовий для написання статей і може бути упередженим.

Здавалося б, вміння нейромереж і чат-ботів акумулювати інформацію з інтернету в єдиний інформаційний матеріал якнайкраще підходять для складання статей у Вікіпедії, проте Джиммі Вейлз, один з авторів цього проєкту, так не вважає. В інтерв'ю Evening Standard він обговорив проблеми впровадження ШІ у функціонал Вікіпедії. Фокус знайомить вас з основними аспектами проблем, які перерахував Вейлз.

У чому проблема чат-ботів на основі ШІ

Вікіпедія — це найбільша та найпопулярніша онлайн-енциклопедія в історії людства, яка містить мільйони статей різними мовами з різних тем. Люди дуже довіряють інформації, отриманої з неї, тому поручити заповнення статей "роботу" на цьому етапі розвитку ШІ поки що не прийнятно.

З іншого боку, каже Вейлз, чат-боти часто "галюцинують", тобто змішують інформацію з різних джерел, але не на одну тему, а відразу на декілька. Зовні матеріал виглядає цілком правдоподібно, але в разі уважного прочитання в них часто знаходяться величезні помилки та неточності в датах, географічних назвах тощо.

"А ще в ШІ є тенденція просто створювати речі з повітря, просто вигадувати нісенітниці, і це просто не нормально. Ми повинні бути дуже обережні з цим", — каже Джиммі Вейлз.

Нещодавно Девід Смердон, економіст з Університету Квінсленду, запитав ChatGPT: "Яка стаття з економіки найцитованіша за весь час?". Чат-бот відповів йому, що це "Теорія економічної історії" Дугласа Норта і Роберта Томаса, що була опублікована в "Журналі економічної історії" в 1969 році. Однак з'ясувалося, що хоч автори були справжніми, але такої статті вони не писали, а журнал її не публікував.

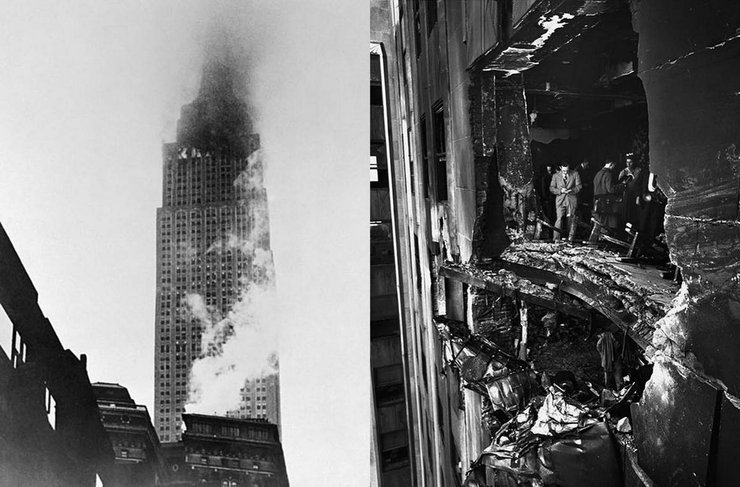

На додаток, сам Джиммі Вейлз не раз переконувався у помилках чат-ботів. Він одного разу запитав: "Чи врізався літак в Емпайр Стейт Білдінг?", на що ШІ йому відповів негативно, хоча така подія справді сталася в 1945 році, коли літак B25 врізався в будівлю.

А ще не лише Вейлз, а й інші експерти зазначають, що чат-боти та нейромережі надто залежать від даних, якими їм "годують" творці та від тих даних, які нейромережа отримує з інтернету. Всі ми знаємо, що вся інформація в інтернеті згенерована людьми, а отже, вона далека від об'єктивності. І якщо ми з вами хоч якось можемо відрізняти фейки від правди, то чат-боти поки що не настільки "розумні", щоб не змішувати правду та вигадку.

Чим може ШІ допомогти Вікіпедії

Втім, суб'єктивізм — це велика проблема і для самої Вікіпедії, зазначає Вейлз. Він визнає, що оскільки Вікіпедія створюється та підтримується добровольцями, більшість з яких є білими чоловіками, сайт має тенденцію ігнорувати теми, які не цікаві цій групі, та висвітлювати інші теми з певної точки зору. Деякі дослідження показали, що статті Вікіпедії мають лівий ухил порівняно з іншими джерелами.

За словами Джиммі Вейлза, його проєкт підтримує будь-які ініціативи щодо залучення більшої кількості жінок та людей з різних культурних та етнічних груп до Вікіпедії. А в майбутньому ШІ допоможе виявляти та усувати упередженість, помилки та допомогти розширити покриття деяких тем, які зараз ігноруються або недостатньо освітлені у Вікіпедії.

На закінчення Вейлз каже, що він оптимістично дивиться на майбутнє Вікіпедії та роль ШІ в ньому. Він стверджує, що він вірить у силу колективного інтелекту та співробітництва між людьми та машинами.

Раніше Фокус писав, що хакери опанували ШІ: кількість спаму збільшилася на 135% і він став "розумнішим".