ШІ не так вже й легко зробити безпечним: експерти розповіли, в чому проблема

У Євросоюзі закон про нейромережі набуде чинності через 2 роки, і тоді може бути надто пізно щось змінювати.

Зазвичай експерти зі штучного інтелекту діляться на дві групи: одні дивляться на ШІ оптимістично, інші — надто песимістично, пише ВВС. І хоча дебати в Європейському парламенті цього тижня про те, як регулювати ШІ, дуже важливі, фахівці видання вирішили розглянути 5 основних постулатів, без обговорення яких зробити нейромережі безпечними не вийде.

Визначити нарешті, що таке "ШІ"

Європейському парламенту знадобилося 2 роки, щоб дати визначення системі ШІ — програмного забезпечення, яке може "для заданого набору цілей, визначених людиною, генерувати такі результати як контент, прогнози, рекомендації або рішення, що впливають на середовище, з яким вони взаємодіють". Тепер потрібно, щоб і в інших державах нарешті базували всі свої закони про нейромережі на цьому визначенні. Без нього формулювання будуть надто розмиті, що дасть лазівки для порушень і маніпуляцій.

Досягнення глобальної угоди

Колишня голова британського Управління штучного інтелекту Сана Харагані зазначає, що технологія не знає меж. "Нам потрібна міжнародна співпраця в цьому питанні — я знаю, що це буде складно, — каже вона. — Штучний інтелект — це не внутрішня справа кожної країни. Ці технології не перебувають у межах однієї держави".

Але, як і раніше, немає плану глобального регулятора ШІ на кшталт Організації Об'єднаних Націй, хоча деякі пропонували його створити, але всі країни поки що мають різні цілі в застосуванні нейромереж. Пропозиції Європейського союзу є найсуворішими та включають класифікацію продуктів ШІ залежно від їхнього впливу — наприклад, спам-фільтр електронної пошти матиме м'якше регулювання, ніж фармакологічні дослідження за допомогою ШІ, які жорстко контролюватимуть.

Великобританія впроваджує спостерігання за ШІ до наявних органів регулювання, наприклад, ті, хто каже, що технологія їх дискримінує, зможуть звернутися до Комісії з питань рівності.

У Сполучених Штатах діють лише добровільні кодекси, і на нещодавніх слуханнях у комітеті зі штучного інтелекту законодавці визнали побоювання про те, чи впораються вони з цим завданням. Китай має намір змусити компанії повідомляти користувачам щоразу, коли використовується алгоритм ШІ.

Забезпечення суспільної довіри

"Якщо люди довіряють і потребують технології, то вони її застосовуватимуть попри будь-які заборони", — говорить представник органів регулювання ЄС від корпорації IBM Жан-Марк Леклерк. У ШІ є величезні можливості для покращення життя людей, але як щодо перевірки кандидатів на роботу чи прогнозування ймовірності того, що хтось вчинить злочин?

Європейський парламент хоче, щоб громадськість була поінформована про ризики, пов'язані з кожним продуктом ШІ. Компанії, які порушують його правила, можуть бути оштрафовані на 30 млн євро або 6% від світового річного обороту в залежності від того, що більше. Але чи можуть розробники передбачити або контролювати, як можна використовувати їхній продукт?

Потрібно вирішити, хто пише правила

Досі ШІ значною мірою контролював сам себе. Точніше, його контролювали творці й дозволяли чи забороняли різний функціонал залежно від своєї точки зору та моралі. За словами Сема Альтмана, засновника OpenAI (чат-бот ChatGPT), великі компанії заявляють, що вони погоджуються з державним регулюванням, що дуже важливо для зниження потенційних ризиків.

"Але чи поставлять вони та їм подібні прибутки вище за людей, якщо будуть надто залучені до написання правил?" — запитують автори матеріалу.

Ви можете посперечатися, що вони хочуть бути якомога ближчими до законодавців, яким доручено встановлювати правила. А засновниця Lastminute.com баронеса Лейн-Фокс каже, що важливо дослухатися не лише до корпорацій.

"Ми повинні залучити громадське суспільство, наукові кола, людей, зачеплених цими різними моделями та перетвореннями", — каже вона.

Необхідно діяти швидко

Компанія Microsoft, яка вклала мільярди доларів у ChatGPT, хоче, щоб він "позбавив вас від рутинної роботи". Чат-бот може генерувати прозу й текстові відповіді, але, як зазначає Сем Альтман, це "інструмент, а не істота".

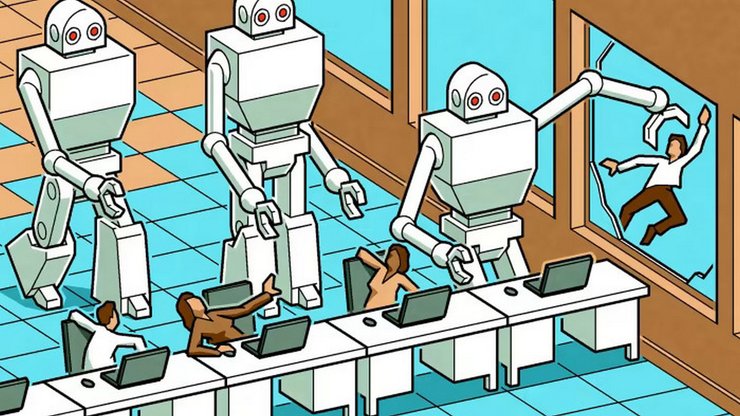

Передбачається, що чат-боти зроблять співробітників продуктивнішими. У деяких галузях штучний інтелект може створювати робочі місця та бути корисним помічником. Але люди вже втрачають роботу через ШІ: минулого місяця British Telecom оголосила, що штучний інтелект замінить 10 тис. робочих місць. Адже з моменту повсюдного розвитку інструментів ШІ пройшло лише трохи більше пів року, і можливості цих мовних моделей зростають феноменальними темпами.

"Закон про штучний інтелект набуде чинності не раніше 2025 року, і це буде надто пізно", — говорить голова відділу технологій ЄС Маргрете Вестагер. Разом із США Маргрете розробляє тимчасовий добровільний кодекс для ІТ-сектору, який може бути готовим протягом кількох тижнів. Це мало б якось згладити ситуацію.

Раніше Фокус розповідав про те, що військові отримають чат-бот "Амелія": допоможе розв'язувати технічні проблеми в армії.