Запутался в показаниях: в США "полицейский" ИИ по ошибке отправил мужчину в тюрьму за убийство

Вердикт системы наблюдения ShotSpotter стал главной уликой, которая оказалась недостоверной.

Житель Чикаго (США) Майкл Уильямс год провел в тюрьме из-за ошибки "секретного" алгоритма искусственного интеллекта ShotSpotter.

Об этом стало известно агентству Associated Press.

В мае 2020 года 65-летний Майкл Уильямс согласился подвести Сафариана Херринга — тогда в Чикаго вспыхнули массовые беспорядки и на улицах города было небезопасно. На перекрестке рядом с авто Уильямса остановился автомобиль, и человек, сидевший на переднем сидении, выстрелил в Херринга. Майкл Уильямс доставил своего раненного пассажира в больницу, но тот, к сожалению скончался. А в итоге в убийстве обвинили Майкла.

Главными уликами по делу стала видеозапись с автомобилем на перекрестке, а также громкий хлопок, который уловили микрофоны камер наблюдения. По словам прокуроров, искусственный интеллект ShotSpotter проанализировал шум и пришел к выводу, что именно Уильямс застрелил жертву.

"Я все пытался понять, как они могут избежать наказания за использование такой технологии против меня? Это не честно", — поделился осужденный с AP. — "Они просто сказали, что обвиняют меня в убийстве первой степени. Когда я услышал мне это, во мне что-то умерло".

В августе мужчину отправили под арест, а спустя почти год прокуратура попросила суд прекратить дело за недостаточностью улик. За месяцы, проведенные в за решеткой, Майкл Уильямс отчаялся и хотел совершить самоубийство, накопив большой запас таблеток. Но, к счастью, он жив.

Как выяснила AP, в ту роковую ночь, датчики ShotSpotter зафиксировали громкий шум по тому же адресу, где ранили Херринга, система сразу же сообщила о этом полиции. Эти данные подтвердили версию следствия о том, что Уильямс застрелил пассажира, хотя не было ни мотива, ни очевидцев. Дополнительной уликой стало видео, на котором другая машина проехала на красный свет якобы с поднятыми окнами. Пистолета у Уильямса не нашли.

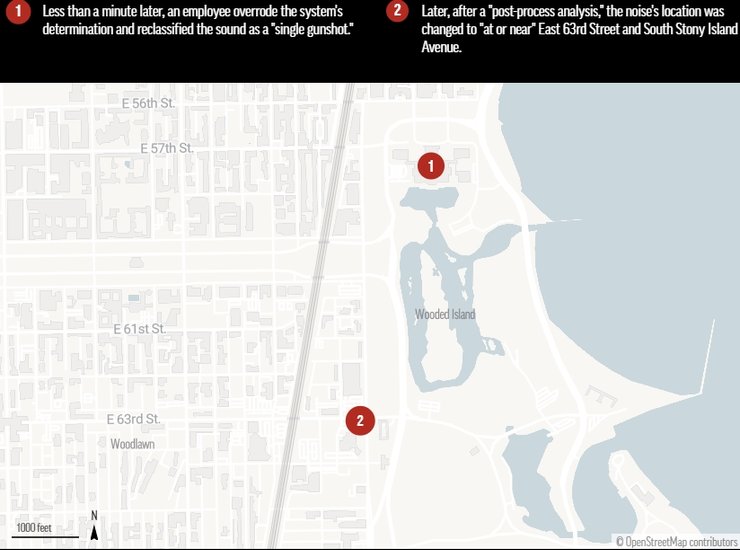

Позже выяснилось, что изначально система ShotSpotter идентифицировала шум как взрыв фейерверка с вероятностью 98%. Однако сотрудник компании после прослушивания аудиофайла пометил шум как выстрел. Кроме того, в процессе постобработки алгоритм сменил местоположение источника шума.

Алгоритм ShotSpotter использует 14 млн звуков, чтобы отличать выстрелы от других шумов и помогать полиции в расследовании преступлений. Такие системы обнаружения устанавливают во многих городах США и все чаще используют в качестве доказательств на судах — примерно 200 раз в 20-ти штатах с 2010 года, причем 91 из этих случаев произошел за последние три года. Работа ShotSpotter обходится США примерно в $95 тыс. за каждую квадратную милю, которую прослушивают микрофоны.

Associated Press исследовало тысячи документов и взяло интервью у десятков государственных защитников, работавших с доказательствами от ShotSpotter. Журналисты выявили ряд серьезных недостатков и определили, что "показания" ИИ не стоит принимать в качестве улик. Как оказалось, система может не замечать стрельбу, которая происходит прямо около ее микрофонов, так как определяет их как звуки фейерверков или сильные выхлопы автомобилей. Кроме того, сотрудники часто изменяют "вердикт" ИИ, самостоятельно прослушивая аудиозаписи.

Заключения судебно-медицинской экспертизы, подготовленные сотрудниками ShotSpotter, использовались в суде для неправомерного обвинения в нападении на полицейских или для получения подсчетов количества выстрелов, предположительно произведенных обвиняемыми. Судьи по ряду дел отвергали такие заключения. При этом компания-разработчик не раскрывает, как именно работают ее технологии.

"Свидетельство эксперта о том, что из пистолета стреляли в определенном месте в определенный момент времени, основанное на технологии ShotSpotter, в настоящее время не приемлемо в суде, потому что на данный момент оно не получило всеобщего признания научного сообщества", — заявил судья Верховного суда Contra Costa Джон Кеннеди.

Ранее блогер создал ИИ-систему для борьбы с ворами посылок. Заметив пропажу, алгоритм запускает громкую сирену и поливает злоумышленников из водометов.