Упізнають в масках і збирають дані: як працюють сервіси розпізнавання людей по фото і чим вони небезпечні

Навіть якщо ви частково потрапили в кадр або на вас була надіта маска, система все одно вас знайде.

Нещодавно журналісти CNN Business забили на сполох: вони виявили в Інтернеті пошуковик, здатний знайти будь-яку людину по фото — PimEyes. Цей сервіс, звичайно, не єдиний у своєму роді, адже є подібні до нього додатки та онлайн-платформи. Однак журналісти звернули увагу на PimEyes тому, що він являє потенційну загрозу для користувачів. У чому ж підступ? Давайте розберемося.

Як працює сервіс розпізнавання осіб PimEyes

Рейчел Мец, журналістка CNN, вирішила провести експеримент. Вона купила преміум-доступ до сервісу за 30 доларів на місяць, який дає доступ до розширеного функціоналу. Яке ж було її здивування, коли пошуковик знайшов фото, про яке вона навіть не підозрювала. Вона випадково потрапила в кадр (дівчина праворуч в окулярах в чорній оправі) під час святкування весілля її друзів у 2013 році. "На знімку моє обличчя видно частково, але це безперечно я", — написала Рейчел.

Оскільки Мец публікується під своїм імʼям у деяких ЗМІ, на сайтах цих медіа міститься коротка інформація про неї. Тому не дивно, що при пошуку стали відомі особисті дані про неї — імʼя, посада та ін. Але коли вона завантажила фото друга, — непублічну людину, що працює в іншій сфері, — PimEyes відразу ж показав приватну інформацію і про нього. "Один з перших результатів було отримано з веб-сайту, в URL-адресі якого вказано його імʼя", — зазначила Мец.

Вона повторила експеримент, результат був таким самим. "У багатьох випадках було потрібно всього лише одне-два клацання мишею, щоб звʼязати особи з іменами", — ділиться журналістка.

Ця пошукова система розпізнавання осіб працює аналогічно іншим подібним системам, порівнюючи параметри особи на зображенні яке ви завантажуєте, з фото осіб в Інтернеті. При цьому точність становить 90%. Станом на серпень 2018 року PimEyes проаналізувала більше 30 мільйонів сайтів, а в листопаді 2019 року компанія заявила, що проаналізувала 900 мільйонів осіб (для порівняння, Clearview AI стверджував, що скопіювали більше 3 мільярдів фотографій з Інтернету за станом на лютий 2020 року).

Чим небезпечний PimEyes

Розробники платформи стверджують, що переслідували благі цілі: "Використовуючи новітні технології, штучний інтелект і машинне навчання, ми допомагаємо знаходити ваші фотографії в Інтернеті і захищатися від шахраїв, викрадачів особистих даних або людей, які використовують ваше зображення незаконно", — йдеться на офіційному сайті. Тут варто прояснити: засновники платформи мають на увазі, що, наприклад, жертви кібербулінгу таким чином зможуть вирахувати, з яких джерел кривдник отримав їх фото, звʼязатися з адміністраторами цих ресурсів і попросити видалити знімки. Адже завантаживши свій (або чужий) фотопортрет на pimeyes.com, пошуковик видасть вам знімки, де зображені ви, а також посилання на ті сайти, де ці знімки були знайдені.

Але на додачу ви отримаєте фото людей, схожих на вас. І серед цих зображень будуть такі, які не дуже вам сподобаються, — з порноакторами, наприклад. А тепер уявіть ситуацію: ви пройшли співбесіду, і тут новий роботодавець вирішив побільше про вас дізнатися. Він знаходить вас в соцмережах, копіює ваше фото, завантажує його в пошуковий рядок PimEyes і бачить, наприклад, такі результати (були і пікантніші, але з етичних міркувань ми їх не публікуємо).

Чи зможете ви довести, що на фото — не ви? А що якщо на еротичному фото справді ви? Результат може бути плачевним: підрив репутації, позбавлення місця.

Уявіть іншу ситуацію: шахрай або сталкер сфотографував вас на вулиці, скористався сервісом і знайшов вас у соцмережах. Що може бути далі, уявити страшно: шантаж, кібербулінг, кіберпереслідування, вимагання, порнопомста і ще багато чого недоброго.

Однак в PimEyes прикриваються тим, що хочуть допомогти людям уникнути таких ситуацій і тим, що свідомо не видають результати з соцмереж (мабуть, щоб не повторити помилку сумнозвісної платформи Clearview AI, на яку подали в суд Facebook, Google, Twitter і, звичайно, виграли його). Сервіс запевняє, що не ідентифікує по іменах ні тих, хто шукає особи, ні тих, чиї обличчя зʼявляються в результатах пошуку. А ще видаляє фото, які завантажуються користувачами, через 48 годин. І тим не менше, експеримент Рейчел Мец показав, що дізнатися імʼя, посаду, місце роботи будь-якої шуканої людини дуже просто.

Які ще існують сервіси розпізнавання облич

Крім пошукових систем, типу Google, існує ряд ресурсів, які працюють за такими ж принципами, наприклад, Tineye і SauceNAO.

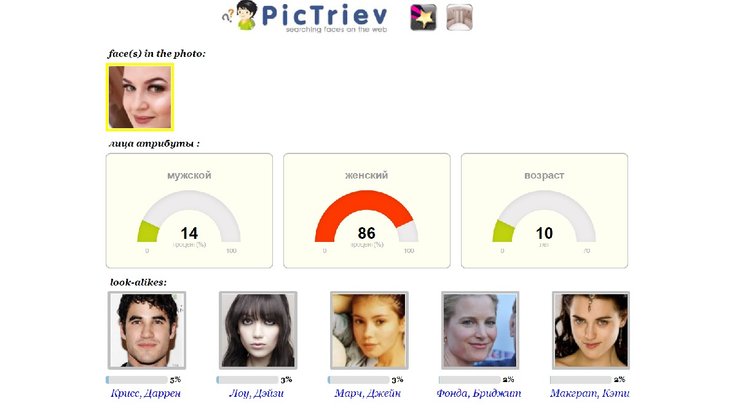

PicTriev, StarByFace і Betaface зможуть знайти фото ваших "двійників" серед селебріті. До того ж, PicTriev спробує визначити стать і вік людини, чиє фото ви завантажили, а також показати на кого саме вона схожа у тому чи іншому відсотковому співвідношенні. Однак робота системи некоректна. Поглянувши на результати, зможете у цьому переконатися: PicTriev правильно визначила стать автора статті, але вік — ні, а ще видала дивний результат "схожості" на якогось Крісса Даррена.

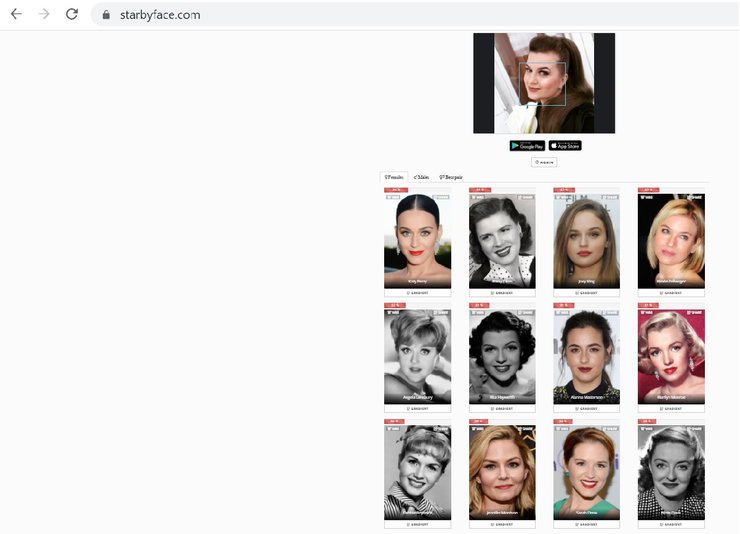

StarByFace працює набагато краще. Врахуйте, що сайт запросить дозвіл на відстеження cookie.

Betaface — платний ресурс і, призначений для корпоративних клієнтів, але у нього є і безкоштовна демо-версія для звичайних користувачів.

Twin Strangers шукає двійників серед звичайних людей. Але без реєстрації на сайті результатів ви не отримаєте.

Мобільний додаток Photo Sherlock (для Android) допоможе перевірити кому дійсно належить той чи інший знімок. Розробники стверджують, що таким чином допомагають користувачам дізнатися, фейкове фото чи ні.

Існують і просунутіші сервіси, проте скористатися ними навряд вдасться, оскільки їх клієнтами є держави. Наприклад, Міністерство громадської безпеки КНР користується послугами Hanwang — системи, здатної розпізнати зображення людей з точністю до 99,5%. Її навіть не бентежать маски, шарфи і накладні бороди.

Небезпека перерахованих вище інструментів у тому, що деякі з них тим чи іншим способом намагаються вивідати користувацькі дані, пропонуючи реєстрацію, копаючись у соцмережах і збираючи "кукі". Деякі з них не попереджають про те, чи будуть вони видаляти завантажені вами фото, чи ні. І навіть якщо вони обіцяють видалити файли, то як це перевірити?..

Раніше ми повідомляли про те, що вчені зʼясували чому технологія розпізнавання емоцій небезпечна для людей. Дослідники з Кембриджського університету впевнені, що технологія далека від досконалості, а тому їй не місце у сферах маркетингу, безпеки і медицини. І довести це вони мають намір на практиці. Також корисно буде дізнатися, як корпорації застосовують технологію Eye tracking, щоб дізнатися про нас все.