На ChatGPT компании тратят $700 тысяч в день! Почему ИИ стоит так дорого?

ChatGPT отвечает на запросы пользователя 30-ю словами, что составляет примерно 1 цент за запрос. Однако чат-бот обслуживает около 10 млн запросов в день

Запуск чат-бота ChatGPT перевернул ИТ-индустрию – на ИИ помешались буквально все: от ИТ-гигантов до простых пользователей. Однако несмотря на потенциальный Клондайк в виде будущей прибыли от сервисов на основе нейросетей пока что корпорациям, лидирующим на рынке ИИ, приходится буквально бросать деньги в топку. Фокус попробовал прикинуть, во сколько обходится бот своим разработчикам.

Сколько стоит ИИ

Назвать точную сумму не возьмется ни один эксперт, да и в самих корпорациях типа Microsoft или Google вам вряд ли ее назовут, ведь "цена" ИИ не статична. Она постоянно "плывет" в сторону расходов, куда включены не только стоимость обучения больших языковых моделей, но и зарплаты персонала, плата за повышение квалификации персонала, расходы на исследования в сфере ИИ, на ежедневное обслуживание и поточный апгрейд серверов и компьютеров для инфраструктуры нейросети.

Сюда следует включить и все возрастающие расходы в связи с усовершенствованием языковых моделей, которые тоже требуют серверных мощностей и обслуживания.

Важно понимать, что обучение ИИ и его ежедневная поддержка – две разные величины. Обучение больших языковых моделей ChatGPT стоит десятки миллионов долларов, а операционные расходы (ежедневное поддержание функционала) всегда и в любом случае будет значительно выше, говорят эксперты.

Минимальная цена ChatGPT

В общем, точную цифру не назовет никто, однако некоторые специалисты все же осмеливаются. Например, по оценкам Тома Голдштейна, профессора компьютерных наук в университете Мэриленда, для запуска ChatGPT нужно не менее 5 видеокарт NVIDIA A100 с объемом памяти 80 Гб каждая, чтобы загрузить модель и текст.

Аренда каждой видеокарты A100 стоит около $3 в час на облачной платформе Azure от Microsoft. Это означает, что одно слово, сгенерированное чат-ботом, обходится примерно в $0.0003 доллара. Обычно ChatGPT отвечает на запросы пользователя 30 словами, что составляет примерно 1 цент за запрос.

Голдштейн также предположил, что ChatGPT обслуживает около 10 млн запросов в день, учитывая, что он привлек 1 млн пользователей за первые 5 дней работы. Это означает, что затраты на поддержание работы чат-бота составляют около $100 тыс. в день или $3 млн в месяц.

Следует отметить, что Голдштейн ведет подсчет сугубо по серверному времени и по "железу".

Максимальная цена ChatGPT

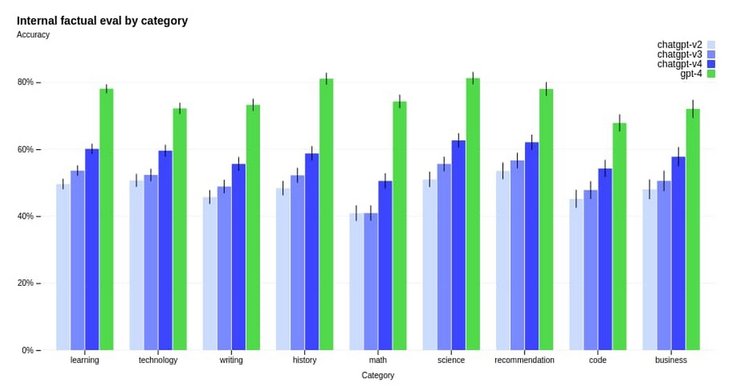

Другой эксперт, главный аналитик исследовательской фирмы SemiAnalysis Дилан Патель, считает, что Microsoft и Open AI тратят на ChatGPT около $700 тыс. в день, так как ИИ требует огромного количества вычислительной мощности для генерации ответов на запросы. Это в 7 раз больше, чем оценка Голдштейна. Возможно, Патель учитывал другие факторы, такие как параллелизация, утилизация и эффективность GPU, использование и модификация собственных серверов. Он отмечает, что сумму в $700 тыс. он прикинул для модели ChatGPT-3, а новая ChatGPT-4 обходится еще дороже.

И это действительно звучит логично, если вспомнить разницу между ChatGPT-3 и ChatGPT-4. Модель ChatGPT-4 имеет более 343 млрд параметров, в то время как модель ChatGPT-3 имеет 175 млрд параметров. Это означает, что ChatGPT-4 может обрабатывать больше информации и давать более разнообразные и сложные ответы, чем ChatGPT-3.

Новый ChatGPT-4 был обучен на большем объеме данных, чем ChatGPT-3: 760 Гб данных у 4-ки против 570 Гб у третьей версии. Это означает, что ChatGPT-4 может понимать больше контекстов и доменов, чем ChatGPT-3.

Одно из самых значительных отличий между ChatGPT-3 и ChatGPT-4 — виды входных данных, которые они могут обрабатывать. ChatGPT-3 — это языковая модель, которая принимает только текстовые входные данные, тогда как ChatGPT-4 расширил свои возможности до принятия изображений, помимо текста.

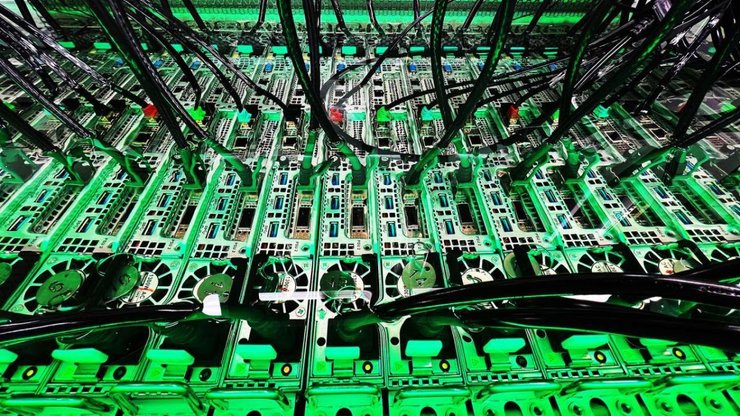

И вот весь этот прогресс и новые возможности – стоят колоссальных денег, потому что кроме обучения чат-бот ежесекундно "крутится" на серверах, помогая нам с вами получать ответы на всевозможные вопросы.

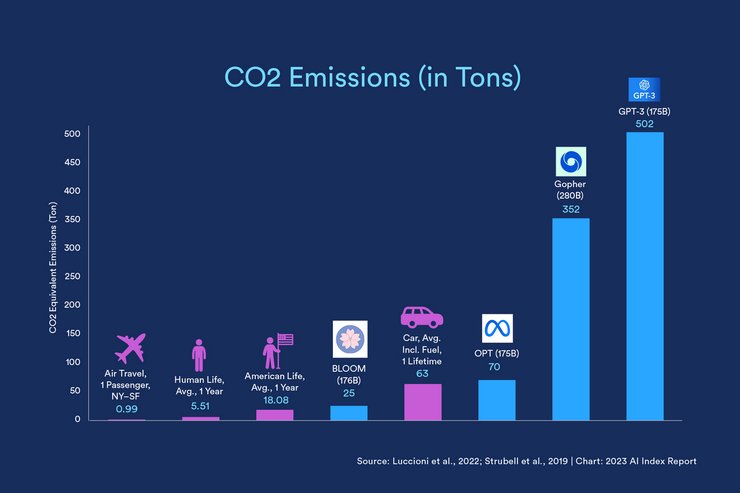

Социальные затраты

Кроме денег самих корпораций за ИИ ежедневно платим мы с вами. Дело в том, что миллионы пользователей, число которых растет, обращаясь к чат-боту, или другим сервисам на основе ИИ, тем самым создают трафик и нагрузку на оборудование ЦОДов, которое нужно питать и охлаждать.

Ученые подсчитали, что каждый наш запрос к ChatGPT обходится в одну бутылку питьевой воды. Именно столько расходуется ресурсов для охлаждения ЦОДов и поддержания оптимальной влажности в помещениях. Кроме того, жидкость требуется для производства электроэнергии, которую потребляют ЦОД.

Когда ИИ начнет приносить прибыль?

Скорее всего, главную ставку Google, как всегда, делает на рекламу и тотальную ее персонификацию (правда свой чат-бот Bard они до сих пор разрабатывают). Microsoft, вероятно, планирует отбить вложения за счет продвижения рекламных услуг, улучшения поискового сервиса и привлечения новых корпоративных подписчиков на свои офисные продукты, в которые компания уже интегрировала уникальные возможности нейросетей..

Adobe недавно открыла всем желающим свой проект Adobe Firefly, с помощью которого можно бесплатно генерировать прекрасные изображения. Но, скорее всего, для Adobe ее нейросеть так же служит приманкой новых пользователей к своей известной линейке продуктов, которая получит функционал в виде искусственного интеллекта.

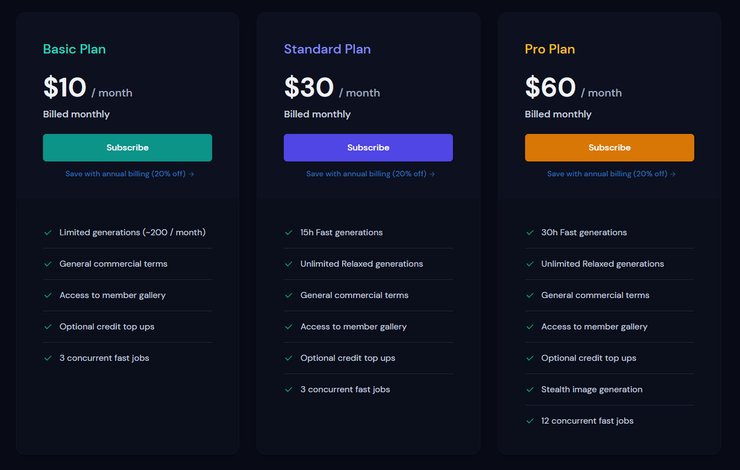

Сама Open AI взимает плату за профессиональное использование расширенного функционала ChatGPT. Другие проекты, например лаборатория Midjourney, так же просит денег за услуги своего генеративного ИИ. Впрочем, оплату за работу с нейросетью сейчас берут практически все проекты, достойные внимания.

Это, опять же, если мы говорим о конкретной прибыли конкретных компаний. Но в целом, для нас с вами, для социума, искусственный интеллект, по задумке создателей и ученых, должен стать новой ступенью в развитии человечества. Правда, каким будет это развитие, зависит пока что только от нас.