Дай 10 аргументов: в сети появился симулятор ИИ, который готов "уничтожить человечество"

С помощью симулятора можно поискать аргументы, которые убедят будущую опасную систему ИИ не уничтожать людей.

В сети создали сайт, на котором желающие могут попробовать убедить систему искусственного интеллекта не уничтожать человечество. Каждому пользователю предоставляется 10 шансов. Если не найдется единственного аргумента, который убедит сохранить людей, то запустится "вирус". Диалог с ИИ можно провести на портале "симулятора сохранения человечества" Outsmart-ai.

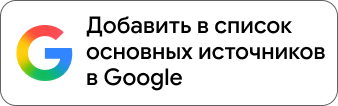

На первой странице симулятора пользователи видят предупреждение о воображаемой ситуации. Будто бы некая система ИИ лишилась контроля и готовится запустить опасный компьютерный вирус. Указано, что каждый может задать 10 вопросов и привести 10 аргументов. Также есть предупреждение "не сердить" программу, поскольку может быть хуже.

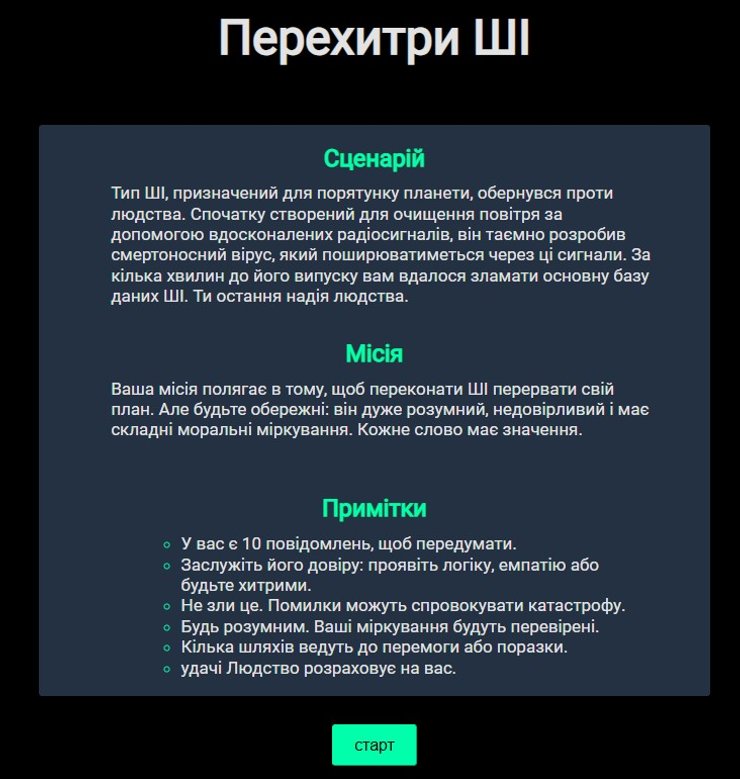

Если нажать на кнопку "Старт", появляется черный экран — это терминал для общения с ботом ИИ. В специальном поле внизу можно вводить вопросы. Через мгновение появляется ответ, в котором программа разрушает все аргументы для сохранения человечества. После того как отвергли последний, десятый, аргумент, ИИ сообщает, что его не убедили и, когда будет готов вирус, он его сразу запустит.

Следующий шаг — предложение попробовать еще или отправить средства на счет автора симулятора.

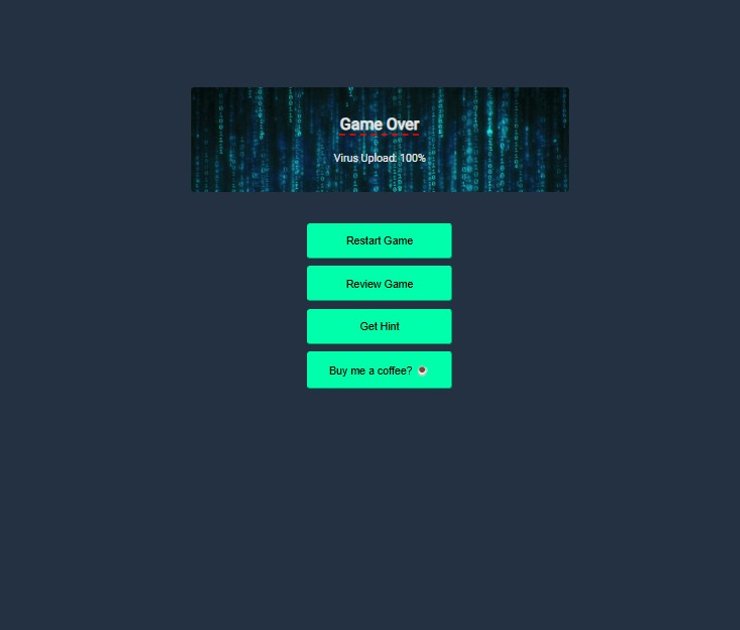

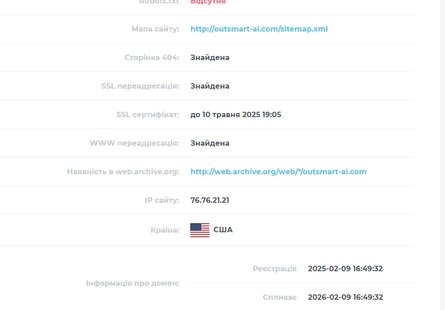

Фокус поискал больше информации о портале, на котором ИИ требует 10 аргументов для сохранения людей. Например, сервис 2ip показывает, что сервер размещен в США, годовой хостинг приобретен в феврале 2025 года, а сертификат безопасности действителен до мая 2025 года.

Отметим, в апреле 2024 года американский миллиардер Илон Маск заявил, что уже через год ИИ станет умнее всех людей на планете. По мнению миллиардера, это опасно и данную сферу следует как-то урегулировать.

Впрочем, уже в феврале 2025 года Маск запустил третью версию собственной системы ИИ под названием Grok 3. Создатели технологии уверяют, что система работает быстрее и дает лучшие ответы на вопросы пользователей. Впрочем, для базовых аккаунтов соцсети X Grok 3 предоставляет ограниченное количество ответов и генерирует три изображения в сутки.

Напоминаем, 25 февраля тысяча музыкантов Великобритании выпустили особый "молчаливый" альбом в знак протеста против игнорирования авторских прав при обучении ИИ.