Україну розкритикували за використання ШІ Clearview AI для розпізнавання тіл окупантів

Використання програми, яка під забороною в багатьох країнах ЄС провокує держави на тотальне стеження за соціумом, — правозахисники.

Протягом тижня після нападу Росії на Україну наша країна отримала можливість використати американський програмний комплекс Clearview AI, який містить у собі базу з 20 млрд фото людей з усього світу. Інструмент знадобився для того, щоб ЗСУ могли ідентифікувати полонених, поранених і загиблих військових з РФ. Результати роботи цієї програми на основі штучного інтелекту справді вражають — ми всі бачили величезну кількість опізнаних окупантів через соцмережі. Проте правозахисники категорично проти використання Clearview AI. Чому так, — розповідає Фокус.

Що не так із програмою Clearview AI

Довкола Clearview AI неодноразово спалахували скандали. Видання Wired повідомляє, що держоргани Італії, Франції, Великої Британії та Австралії вимагали від розробників Clearview AI видалити з бази фото своїх громадян, хоча наскільки виконано таку вимогу, не відомо. Тим не менш, безліч судових позовів проти Clearview AI не заважають компанії успішно діяти на ринку та продавати свій продукт правоохоронним структурам і спецслужбам у всьому світі.

Критиці піддається твердження компанії про те, що програма здатна впізнавати обличчя загиблих людей, які "одержали великі ушкодження", але доказів цим словам немає. Судовий антрополог Луїс Фондебрідер, який працював у гарячих точках по всьому світу, каже, що технології розпізнавання облич дуже корисні, але ніколи не зможуть дати 100-відсоткової гарантії порівняно з класичним і перевіреним тестом на ДНК. "Не існує чарівних рішень для ідентифікації", — наголошує він.

Права мертвих і живих

Зі свого боку, різні правозахисні організації, такі як Amnesty International та Electronic Frontier Foundation стверджують, що використання Міністерством оборони України програмного комплексу Clearview AI хоч і є необхідністю в умовах війни, але несе ризики порушення прав людини незалежно від того, чи жива людина чи мертва, і на чиєму боці вона воює.

Крім того, правозахисники критикують недосконалість ПЗ. Під час розпізнавання облич загиблих Clearview AI іноді дає збій і неправильно ідентифікує особистість. Рідні російських солдат бачать повідомлення на сайтах і в телеграм-каналах про загибель їхнього родича, а пізніше з'ясовується, що він живий. Це завдає родичам "психологічної травми", кажуть правозахисники. З морального погляду, порушенням прав і живих і мертвих є те, що дані про особу загиблих знаходяться у вільному доступі в інтернеті.

З іншого боку, згідно з нормативами ООН та Червоного Хреста упізнання, інформування родичів і гідне поховання жертв війни будь-яка зі сторін є імперативом у галузі прав людини, що затверджено в багатьох міжнародних документах. Турбота про мертвих є однією з найдавніших людських практик, особливо якщо йдеться про загиблих під час воєн. Так було за всіх часів, стверджує історик Томас Лакер.

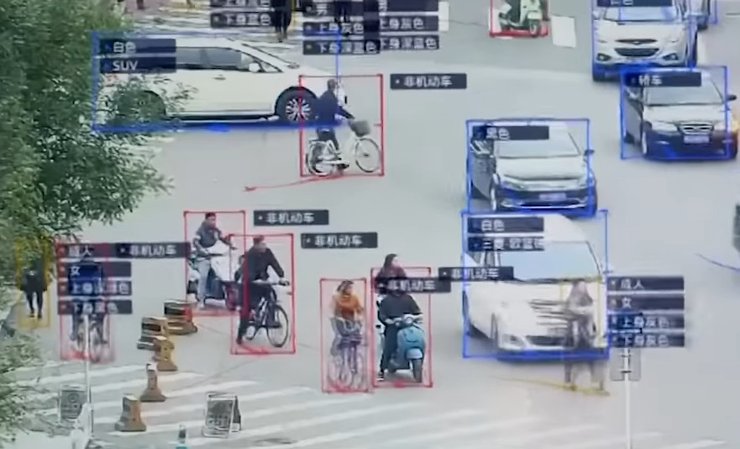

Clearview AI як привід для тотального стеження

Використання ШІ від Clearview AI як необхідний захід для розпізнавання загиблих росіян тіньовим способом легалізує тотальне стеження і збір даних про людину, стверджують правозахисники із Surveillance Technology Oversight Project та Immigrant Defense Project. Вони вважають, що збирання персональних даних громадян, зокрема численні фото, "підсилює расистську поліцейську діяльність, загрожує праву на протест і може призвести до неправомірного арешту". Утім, у тоталітарних державах давно діють подібні системи власної розробки, а в Китаї навіть запроваджено "соціальний рейтинг".

Проте, варто пам'ятати, що після того, як ви почали користуватися інтернетом і смартфоном, усі ваші дані — фото, відбитки пальців, місце проживання, маршрути переміщень та копії документів — давно знаходяться на серверах Google, Apple, Microsoft, Facebook, Telegram, Viber тощо, або в Китаї (якщо використовуєте смартфони китайських брендів). Збору даних уникнути складно, проте не варто розкидатися своїми персональними даними в мережі. Просто потрібно чітко розуміти, що і куди ви відправляєте та якому сервісу довіряєте свої персональні дані.

Утім, найпросунутіші правозахисники, за великим рахунком, стурбовані тим, що держави незабаром за допомогою ШІ-алгоритмів зберуть повні бази про кожного члена суспільства: враховуючи відбитки пальців, приклад голосу, фото та навіть ДНК. І тоді, у недалекому майбутньому, роботизовані системи та дрони зможуть особисто полювати "за неугодними", як у фантастичних романах-утопіях.

Раніше Фокус писав, що в Україні створили додаток для перевірки людей щодо зв'язку з "російським світом".